Вам надоели сложные инструменты для веб-скрейпинга, которые превращаются в работу на полный рабочий день?

Мы понимаем, что они могут быть сложны в использовании.

Извлечение данных с сайтов может стать настоящей головной болью, особенно когда возникают препятствия.

Вы тратите драгоценное время впустую и никуда не продвигаетесь.

Вот почему мы составили список лучших. Создатели скрапа Альтернативы. Это руководство поможет вам найти мощный и простой инструмент для получения необходимых данных.

Давайте приступим к очистке!

Какие существуют лучшие альтернативы программам для создания скретчей?

Если вы ищете более эффективный способ сбора данных, вы обратились по адресу.

Мы проделали работу, чтобы найти лучшие инструменты, которые проще и мощнее в использовании. В наш список входят как простые варианты, не требующие написания кода, так и мощные инструменты для разработчиков.

Вы найдете идеальный инструмент для своих нужд.

1. ScrapingBee (⭐4.8)

ScrapingBee — это API для веб-скрейпинга, разработанный для разработчиков.

Она берет на себя сложные задачи, такие как управление безголовыми браузерами и ротация прокси-серверов.

Этот API для сбора данных идеально подходит для разработчиков, которые хотят избежать технических сложностей, связанных с веб-скрейпингом.

Это особенно полезно для сбора ресурсов. социальные сети данные для маркетинговых исследований.

Наше мнение

Получите данные Вам потребуется получить данные с более чем 98% веб-страниц. Мощный API для веб-скрейпинга от ScrapingBee предлагает рендеринг JavaScript, API поиска Google и возможность извлечения структурированных данных с точностью до 99,5% на динамических сайтах.

Основные преимущества

- Мы обо всём позаботимся за вас: Он автоматически управляет ротацией прокси и рендерингом JavaScript.

- Простой API: Вы получаете чистые данные всего одним простым вызовом API.

- 99,9% времени безотказной работы: Платформа известна своей высокой надежностью и стабильной работой.

- Обширная документация: Предоставляет понятную и исчерпывающую документацию с примерами кода для различных языков, что упрощает начало работы.

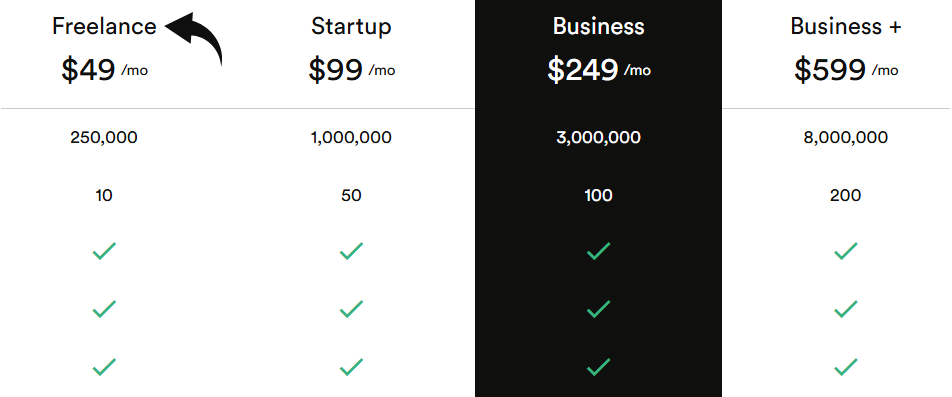

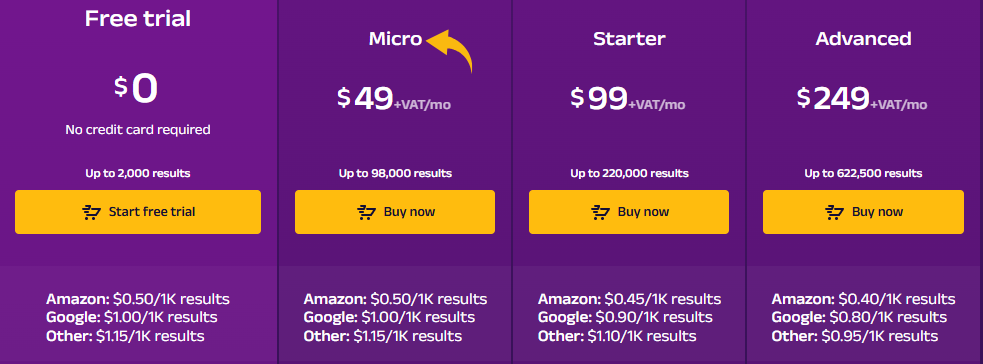

Цены

Все планы будут оплачивается ежегодно.

- Фриланс: 49 долларов в месяц.

- Запускать: 99 долларов в месяц.

- Бизнес: 249 долларов в месяц.

- Бизнес+: 599 долларов в месяц.

Плюсы

Минусы

2. Apify (⭐4.5)

Apify — это облачная платформа для веб-скрейпинга и автоматизация.

Он создан как для программистов, так и для тех, кто не занимается программированием.

Вы можете использовать его огромную библиотеку готовых акторов для сбора данных с веб-сайтов без написания какого-либо кода.

This tool offers solutions for социальные сети извлечение данных.

Его гибкая платформа и большой набор инструментов. делать Начать соскабливать очень легко.

Наше мнение

Хотите сами убедиться в возможностях Apify? Наша платформа использовалась для сбора данных с более чем 2,5 миллионов веб-страниц и обработки более 500 ТБ данных за один месяц. Готовы начать?

Основные преимущества

- Масштабная торговая площадка: В магазине Apify Store представлено более 5000 готовых к использованию парсеров и инструментов автоматизации, называемых акторами.

- Максимальная масштабируемость: Разработанная для задач корпоративного уровня, она способна обрабатывать масштабные операции сканирования миллионов страниц.

- Удобно для разработчиков: Предоставляет SDK с открытым исходным кодом и поддерживает написание пользовательского кода на Python и JavaScript.

- Расширенное планирование: Автоматизируйте задачи сбора данных, запустив их в определенное время или с заданными интервалами без необходимости ручной работы.

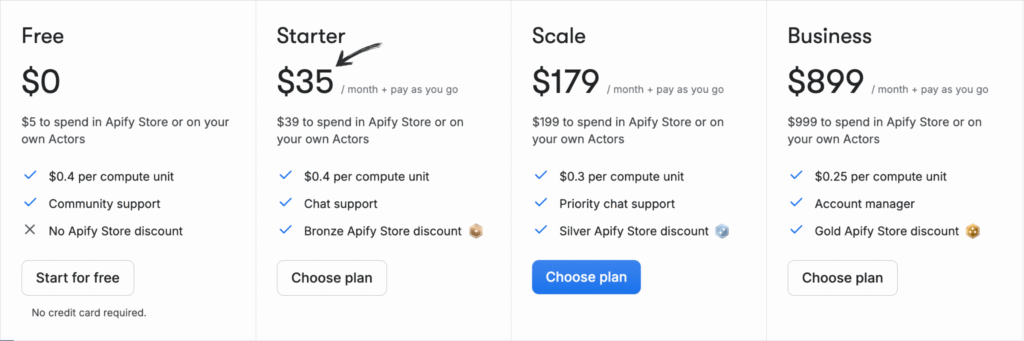

Цены

Все планы будут оплачивается ежегодно.

- Бесплатно: 0 долларов в месяц + оплата по факту использования.

- Стартер: 35 долларов в месяц + оплата по факту использования.

- Шкала: 179 долларов в месяц + оплата по факту использования.

- Бизнес: 899 долларов в месяц + оплата по факту использования.

Плюсы

Минусы

3. Oxylabs (⭐4.0)

Oxylabs — это надежная компания, специализирующаяся на веб-аналитике и предлагающая мощные прокси-сервисы и инструменты для веб-скрейпинга.

Она известна своей обширной сетью IP-адресов и расширенными функциями.

Она может собирать данные в режиме реального времени из социальных сетей и других источников.

Их мощный веб-скрейпер создан для обработки сложных и масштабных задач по извлечению данных.

Наше мнение

Получите доступ к данным с помощью ведущего прокси-сервиса. Oxylabs предоставляет более 175 миллионов резидентных прокси, 2 миллиона выделенных прокси для центров обработки данных и 20 миллионов мобильных прокси для любых проектов.

Основные преимущества

- OxyCopilot AI Assistant: Этот инструмент позволяет генерировать запросы на сбор данных, используя простой, естественный язык.

- Огромная сеть прокси-серверов: Обладает одним из крупнейших в мире пулов прокси-серверов, включающим IP-адреса из 195 стран.

- Гарантированный успех: Технология распознавания отпечатков пальцев на основе искусственного интеллекта и обход CAPTCHA, используемые платформой, обеспечивают высокую вероятность успеха даже на самых сложных сайтах.

- Безопасность корпоративного уровня: Платформа сертифицирована по стандарту ISO/IEC 27001:2022, что гарантирует высокий уровень безопасности и конфиденциальности данных.

Цены

- Бесплатная пробная версия: $0.

- Микро: 49 долларов в месяц + НДС.

- Стартер: 99 долларов в месяц + НДС.

- Передовой: 249 долларов в месяц + НДС.

Плюсы

Минусы

4. Просмотр ИИ (⭐3.8)

Browse AI — это веб-сервис без использования кода. скребок.

Это позволяет обучить робота извлекать данные с любого веб-сайта. Удобный интерфейс с возможностью выбора параметров упрощает извлечение данных.

В него также входят предварительно настроенные роботы для сбора данных из социальных сетей, что делает его отличным инструментом для веб-скрейпинга для маркетологов.

Раскройте его потенциал с помощью нашего Просмотрите руководство по ИИ..

Наше мнение

Готовы сэкономить время и получить необходимые данные? Browse AI может обрабатывать миллионы веб-сайтов. Убедитесь сами, насколько простым может быть веб-скрейпинг.

Основные преимущества

- Код не требуется: Его интерфейс, основанный на принципе "наведи и щелкни", позволяет любому пользователю создать программу для сбора данных за считанные минуты.

- Адаптивность на основе искусственного интеллекта: Этот инструмент автоматически адаптируется к изменениям в структуре веб-сайта, обеспечивая постоянную согласованность ваших данных.

- Более 7000 интеграций: Легко подключайте собранные данные к таким приложениям, как Google Sheets, Airtable и Zapier.

- Готовые роботы: Получите доступ к библиотеке готовых роботов для выполнения распространенных задач на популярных веб-сайтах, что позволит вам сэкономить еще больше времени.

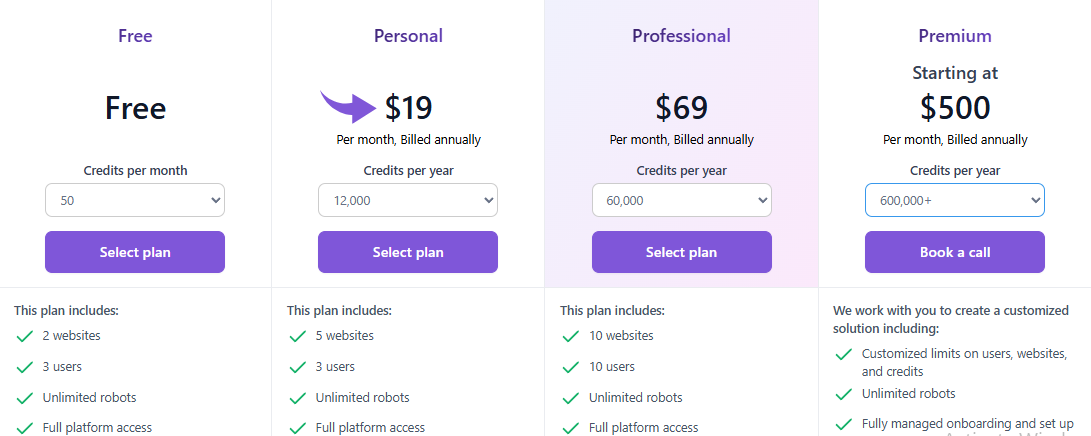

Цены

Все планы будут оплачивается ежегодно.

- Бесплатно: $0.

- Личное: 19 долларов в месяц.

- Профессиональный: 69 долларов в месяц.

- Премиум: От 500 долларов в месяц.

Плюсы

Минусы

5. Zyte (⭐3.5)

Zyte — это полнофункциональная платформа для веб-скрейпинга.

Эта компания существует уже давно и пользуется доверием многих.

Это помогает разработчикам размещать и управлять своими веб-краулерами в облаке. Они также предлагают мощный API, который обеспечивает защиту от ботов.

Платформа Zyte предназначена для крупномасштабного извлечения данных из социальных сетей.

Наше мнение

Получите самый надежный веб-сайт данные с помощью API Zyte. Добейтесь точности данных 99,99% для ваших проектов с помощью этого высококачественного API для веб-скрейпинга и оптимизируйте процесс извлечения данных уже сегодня.

Основные преимущества

- Автоматическая разблокировка: Прекратите возиться с прокси; Zyte API — это мощный автоматизированный инструмент для обработки блокировок.

- Бесшовная интеграция со Scrapy: Если вы разработчик, использующий фреймворк Scrapy, Zyte идеально вам подойдет.

- Извлечение данных с помощью ИИ: Этот инструмент способен автоматически идентифицировать и анализировать данные, уменьшая необходимость в правилах ручного анализа.

- Встроенный безголовый браузер: Нет необходимости в сторонних безголовых браузерах, поскольку Zyte предоставляет браузер, оптимизированный для масштабного веб-скрейпинга.

Цены

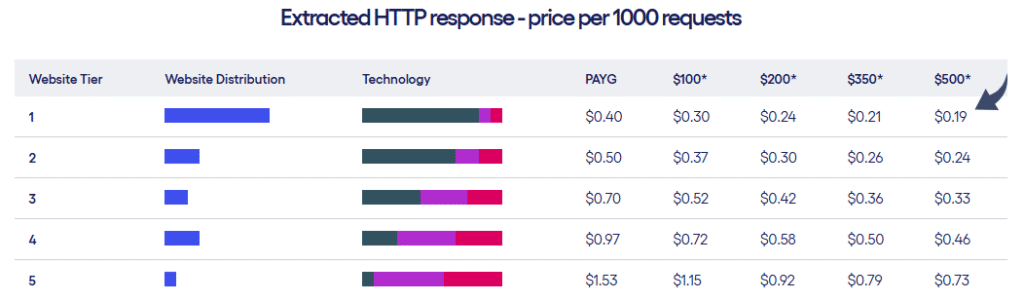

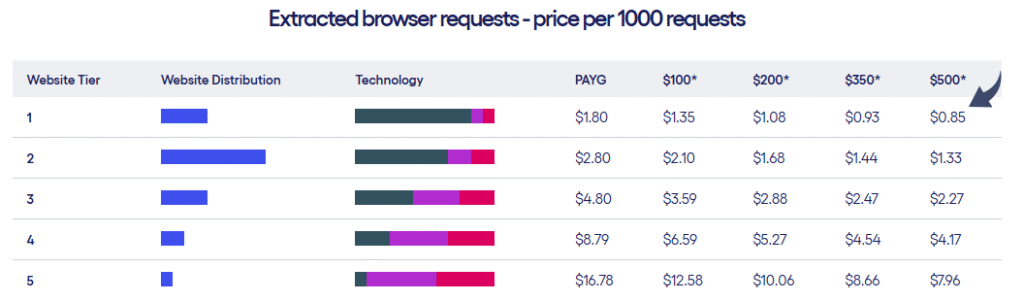

- Zyte предлагает два типа тарифных планов в зависимости от уровня веб-сайтов и количества отправляемых вами запросов.

Плюсы

Минусы

6. ScrapeGraph AI (⭐3.2)

ScrapeGraph AI — это уникальная библиотека Python, использующая искусственный интеллект для сбора данных с веб-сайтов.

Просто укажите, какую информацию вы хотите получить, простым и понятным языком.

Затем программа использует графовый подход для извлечения данных.

Это новый подход к веб-скрейпингу. Этот инструмент на основе искусственного интеллекта упрощает извлечение сложных данных.

Наше мнение

Более 350 ведущих специалистов доверяют ScrapeGraphAI благодаря его мощным возможностям веб-скрейпинга на основе искусственного интеллекта. Получите 20% повышение эффективности в течение следующих 48 часов.

Основные преимущества

- Парсинг естественного языка: Вы можете указать, что именно нужно извлечь, используя простые, похожие на человеческие подсказки.

- Библиотека с открытым исходным кодом: Разработчики могут использовать её мощную библиотеку с открытым исходным кодом для максимального контроля.

- Функция Markdownify: Она может преобразовывать целые веб-страницы в чистые, читаемые документы в формате Markdown.

- Агентский Скребок: Искусственный интеллект способен автономно перемещаться по веб-сайтам и взаимодействовать с ними для выполнения сложных многоэтапных задач.

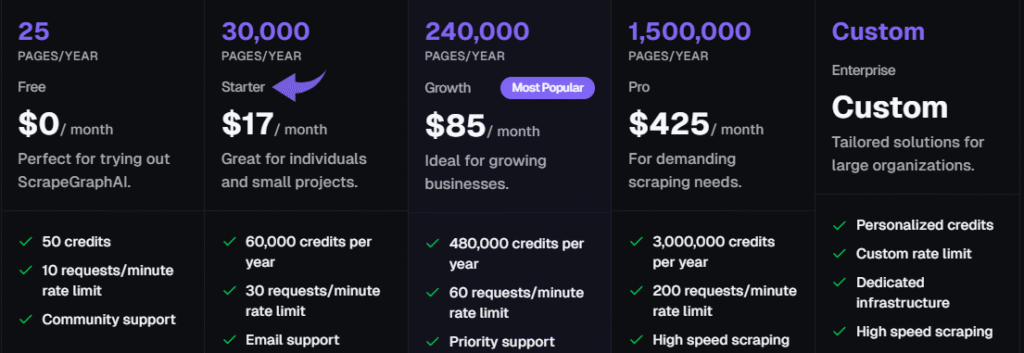

Цены

Все планы будут оплачивается ежегодно.

- Бесплатно: 0 долларов в месяц.

- Стартер: 17 долларов в месяц.

- Рост: 85 долларов в месяц.

- Плюсы: 425 долларов в месяц.

- Предприятие: Индивидуальное ценообразование.

Плюсы

Минусы

7. ThorData (⭐3.0)

ThorData — это платформа, предлагающая как прокси-инфраструктуру, так и инструменты для веб-скрейпинга.

Его универсальный API для сбора данных разработан таким образом, чтобы имитировать реальное поведение человека при решении сложных задач сбора данных.

Этот веб-скрейпер предлагает как вариант без написания кода, так и мощный API для разработчиков.

Она может собирать данные в режиме реального времени с платформ социальных сетей.

Наше мнение

Оцените непревзойденную безопасность с ThorData. Это данные Процесс проверки гарантирует 99,7% успеха. Благодаря круглосуточной поддержке и среднему времени ответа менее 3 минут вы можете быть уверены в качестве соединения. Получите доступ к более чем 60 миллионам IP-адресов и защитите свои данные.

Основные преимущества

- Огромный пул IP-адресов: Предлагает более 60 миллионов IP-адресов для жилых помещений, полученных этичным способом.

- Высокая степень анонимности: Благодаря высококачественным прокси-серверам ваша деятельность по сбору данных останется незамеченной.

- Оплата по факту использования: Система выставления счетов прозрачна; вы платите только за использованный трафик, а не за неудачные запросы.

- Встроенный скрейпер: Включает в себя веб-скрейпер, не требующий написания кода, и универсальный API, поэтому для простых проектов вам не понадобится отдельный инструмент.

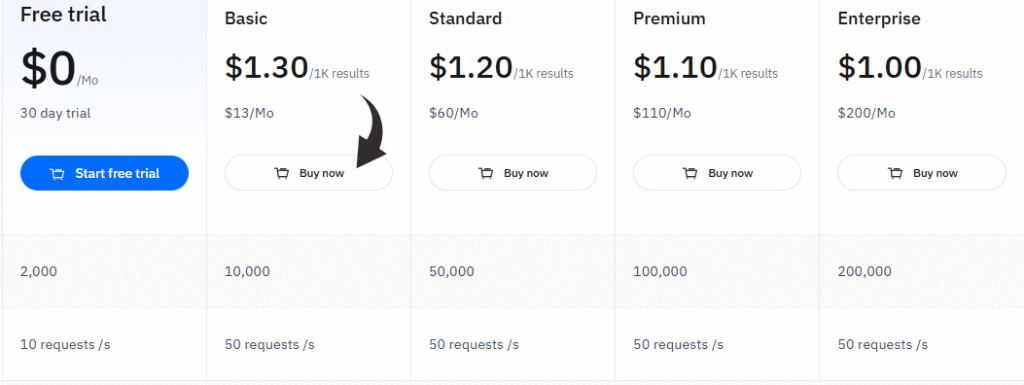

Цены

- Бесплатная пробная версия: 0 долларов в месяц, 30-дневный пробный период.

- Базовый: 13 долларов в месяц.

- Стандарт: 60 долларов в месяц.

- Премиум: 110 долларов в месяц.

- Предприятие: 200 долларов в месяц.

Плюсы

Минусы

Руководство для покупателей

Мы оценивали каждый продукт по нескольким ключевым факторам, чтобы убедиться, что наши рекомендации являются наилучшими.

Мы рассмотрели, что отличает каждый веб-скрейпер от других и чего ему может не хватать.

Наш исследовательский процесс был простым и направлен на предоставление вам информации, необходимой для принятия правильного решения.

Вот как мы это сделали:

- Цены: Мы проверили цены на каждый инструмент, включая наличие бесплатной пробной версии или бесплатного тарифного плана для начала работы. Мы рассмотрели различные модели ценообразования, чтобы найти варианты для разных бюджетов.

- Функции: Мы тщательно изучили возможности каждого инструмента. Нас интересовали такие вещи, как удобный интерфейс «наведи и щелкни», возможность обработки данных в реальном времени и наличие мощного API. Мы также проверили, есть ли интеграция с Google Sheets для упрощения сбора данных.

- Недостатки: Мы искали любые потенциальные недостатки. Была ли сложная кривая обучения? Испытывал ли инструмент трудности с защитой от сбора данных? Чего-то не хватало, что сделало бы инструмент менее полезным для таких задач, как... тикток или на других конкретных платформах, таких как социальные сети?

- Поддержка и сообщество: Мы изучили, какую поддержку предлагает каждый сервис. Мы проверили, есть ли у них форум сообщества, полезные обучающие материалы или прямая поддержка клиентов. Мы также рассмотрели их политику возврата средств.

- Производительность: Мы оценили, насколько хорошо каждый инструмент может извлекать данные и возвращать их в виде чистых, структурированных данных. Мы также рассмотрели, насколько хорошо парсеры справляются с распространенными проблемами, не блокируясь.

- Интеграция ИИ: Мы искали инструменты, использующие агентов искусственного интеллекта или другие функции ИИ, чтобы сделать сбор данных более интеллектуальным и эффективным.

Подведение итогов

Найти подходящий и оптимальный инструмент для ваших нужд может быть непросто.

Мы рассмотрели множество различных вариантов, чтобы помочь вам найти лучший инструмент для сбора веб-данных.

Мы учитывали ключевые характеристики, цены и удобство использования для пользователей.

Теперь вы можете выбрать инструмент, который подходит именно вам.

Независимо от того, нужен ли вам простой интерфейс «наведи и щелкни» или мощный API, обрабатывающий сложные запросы.

Выбрав подходящий инструмент, вы сможете извлекать данные с различных платформ и веб-сайтов, что поможет вам создать то, что необходимо для масштабирования.

Часто задаваемые вопросы

Is web scraping illegal?

Generally, no. It’s legal for public data. Courts, like in the hiQ vs. LinkedIn case, have protected the scraping of publicly available information. However, bypassing paywalls or harvesting personal data is a legal “no-go.” Always respect a site’s robots.txt file.

Is it possible to scrape data from a website?

Absolutely. Almost any public site can be scraped. While some sites use advanced anti-bot shields, modern tools like ScraperAPI are designed to bypass these blocks effortlessly. If the data is visible to a standard browser, a scraper can likely extract it.

Which is best for web scraping?

It depends on your skill. Developers typically swear by Scrapy or BeautifulSoup for total customization. If you prefer a visual approach, Octoparse is the winner. For massive enterprise projects requiring heavy anti-bot protection, Яркие данные is the undisputed industry leader.

What is the best tool for web scraping?

Bright Data is widely considered the best for power and reliability. It handles proxy rotation and CAPTCHAs without breaking a sweat. For those on a budget, ParseHub or Octoparse offer excellent free tiers that work perfectly for smaller, straightforward projects.

Which scraping tool is best for beginners?

Octoparse is the gold standard for non-coders. It features a point-and-click interface, allowing you to select data directly on the screen. No coding required. ParseHub is another fantastic visual alternative that makes complex data extraction feel like a simple walkthrough.

Can ChatGPT create a web scraper?

Yes, and it’s fast. ChatGPT can generate Python scripts using BeautifulSoup or Selenium in seconds. While it provides the logic, you still need to execute the code yourself. It’s perfect for simple tasks, though complex sites might require some manual fine-tuning.

What is an example of web scraping?

Price monitoring is the classic use case. Retailers scrape sites like Amazon to adjust their own prices dynamically. Other examples include pulling недвижимость listings, gathering sports stats for analysis, or aggregating news for AI training. It turns the web into a structured database.

More Facts about Scrape creators Alternatives

- ScrapingBee, Apify, and Octoparse are great choices if you don’t want to use Scrape Creators. They work well for social media and online shops.

- In 2026, the best tools for getting data from websites are Bright Data, ScrapingBee, Apify, and Octoparse.

- ScrapingBee is a helpful tool that handles tricky website code and hides your identity while you work.

- ScrapingFish is built to be very fast and doesn’t waste any time.

- ScrapingAnt is an easy-to-use tool that gets the job done without any extra fuss.

- Scrapfly is a simple tool that can grow as your project gets bigger.

- ZenRows is great at getting past “robot blockers” on modern websites to get the info you need.

- Oxylabs has a special tool that helps it get into “stubborn” websites that try to block users.

- A web scraper is good for projects that need to pull large amounts of data regularly. It can even read websites that change or update while you are looking at them.

- Scraper API lets you take data from any public site without worrying about technical blocks like “I am not a robot” tests (CAPTCHA). You can even try it for free for 7 days.

- ParseHub is a program you download to your computer that helps you get data without writing any code.

- Scrapy is a famous tool for giant projects, but it’s like a “manual” car—you have to set up the tricky parts yourself.

- Most of these tools are easy to use, with simple buttons that make the work easier. Many “no-code” tools can do the work automatically, saving you time.

- No-code tools are smart enough to read websites that use complex computer code (JavaScript).

- You can save your data in common files like Excel, Google Sheets, or simple lists (JSON).

- Some tools have “starter kits” or templates that help you begin scraping popular websites right away.

- Bright Data has the world’s largest network, with over 150 million connections. It is a specialist at helping people scrape shopping websites.

- Web scraping APIs make it much easier to pull information off the web and turn a messy website into a neat, organized list.

- People use these tools for things like market research or seeing what prices their competitors are charging.

- Octoparse has a “visual строитель” that automatically highlights lists and tables on a website for you. It lets you turn any website into a list without knowing how to code.

- Огненный ползунок is a newer tool made specifically for AI. It turns web pages into a format that AI programs like to read.

- Selenium and Playwright are tools that act like a real person clicking and scrolling on a website.

- Kadoa is a very smart tool that figures out what data is on its own, even if the website changes its layout.

- Oxylabs has an AI helper called OxyCopilot that lets you request the data you want using everyday words.