你是否厌倦了那些复杂繁琐、感觉像是全职工作的网络爬虫工具?

我们明白,它们使用起来可能很复杂。

从网站提取数据可能很麻烦,尤其是在遇到障碍时。

你这是在浪费宝贵的时间,却毫无进展。

这就是为什么我们整理了一份最佳清单。 抓取创建者 其他选择。本指南将帮助您找到一款功能强大且易于使用的工具,以获取所需数据。

让我们开始抓取吧!

有哪些最佳的 Scrape Creators 替代方案?

如果你正在寻找更好的数据抓取方法,那么你来对地方了。

我们已经为您精心挑选了最便捷、最强大的工具。我们的列表涵盖了简单易用的无代码选项和功能强大的开发者工具。

您一定能找到满足您需求的完美工具。

1. ScrapingBee (⭐4.8)

ScrapingBee 是一个专为开发者设计的网页抓取 API。

它可以帮你处理那些困难的部分,比如管理无头浏览器和轮换代理。

这款抓取 API 非常适合想要避免网页抓取技术难题的开发者。

它尤其适用于收集 社交媒体 用于市场调研的数据。

我们的观点

获取 数据 您需要从超过 98% 的网页中获取所需信息。ScrapingBee 强大的网页抓取 API 提供 JavaScript 渲染、Google 搜索 API,并且能够在动态网站上以高达 99.5% 的准确率提取结构化数据。

主要优势

- 为您处理一切: 它可以自动管理代理轮换和 JavaScript 渲染。

- 简易API: 只需一次简单的 API 调用,即可获得干净的数据。

- 99.9% 正常运行时间: 该平台以其高可靠性和稳定的性能而闻名。

- 详尽的文档: 提供清晰全面的文档,并附有多种语言的代码示例,方便用户快速上手。

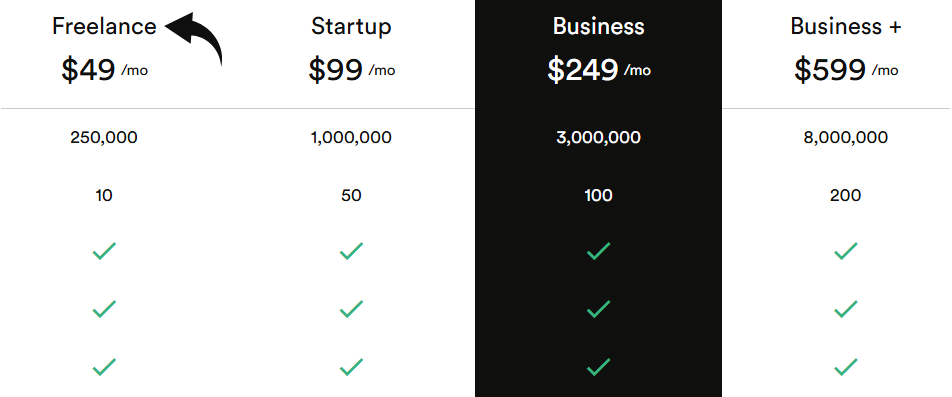

定价

所有计划都将是 按年计费.

- 自由职业者: 每月49美元。

- 创业公司: 每月99美元。

- 商业: 每月249美元。

- 商业+: 每月599美元。

优点

缺点

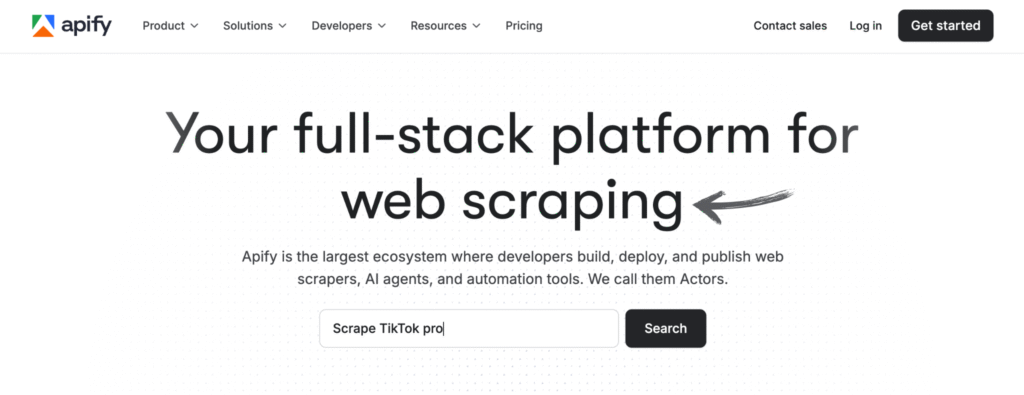

2. Apify (⭐4.5)

Apify是一个基于云的网络爬虫平台, 自动化.

它既适合程序员使用,也适合非程序员使用。

你可以使用其庞大的预构建 Actor 库来抓取网站,而无需编写任何代码。

This tool offers solutions for 社交媒体 数据提取。

其灵活的平台和丰富的工具集 制作 开始刮擦很容易。

我们的观点

想亲身体验 Apify 的强大功能吗?我们的平台在一个月内就抓取了超过 250 万个网页,处理了超过 500 TB 的数据。准备好开始了吗?

主要优势

- 大型市场: Apify Store 拥有超过 5,000 个即用型抓取工具和自动化工具,称为 Actors。

- 极致可扩展性: 它专为企业级任务而设计,可以处理数百万页的大规模抓取。

- 对开发者友好: 提供开源 SDK,并支持 Python 和 JavaScript 自定义代码。

- 高级排班: 自动执行抓取任务,使其在特定时间或间隔运行,无需任何手动操作。

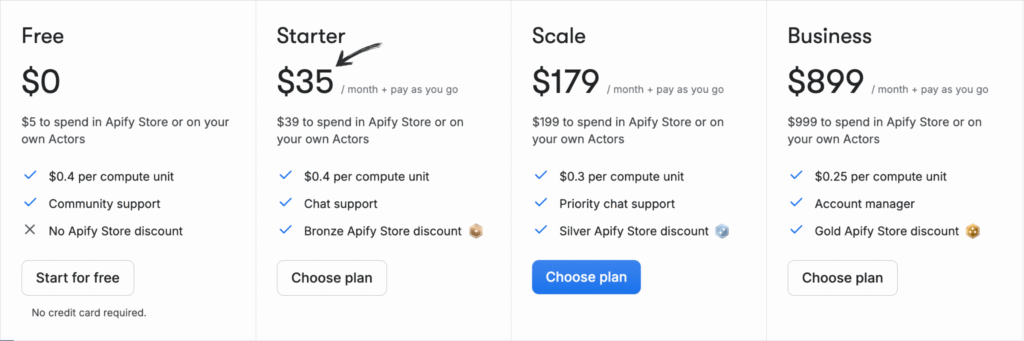

定价

所有计划都将是 按年计费.

- 自由的: 每月0美元,另加按需付费。

- 起动机: 每月 35 美元 + 按需付费。

- 规模: 每月 179 美元 + 按需付费。

- 商业: 每月 899 美元 + 按需付费。

优点

缺点

3. Oxylabs(⭐4.0)

Oxylabs 是一家值得信赖的网络情报公司,提供强大的代理服务和网络抓取工具。

它以其庞大的 IP 网络和先进的功能而闻名。

它可以收集来自社交媒体和其他来源的实时数据。

他们强大的网络爬虫旨在处理复杂的大规模数据提取。

我们的观点

使用领先的代理服务解锁数据。Oxylabs 拥有超过 1.75 亿个住宅代理、200 万个专用数据中心代理和 2000 万个移动代理,可为您提供任何项目所需的 IP 地址。

主要优势

- OxyCopilot AI助手: 该工具允许您使用简单、自然的语言生成网络爬虫请求。

- 庞大的代理网络: 拥有全球最大的代理池之一,IP 地址来自 195 个国家/地区。

- 保证成功: 该平台的 AI 驱动指纹识别和 CAPTCHA 绕过功能,即使在最难访问的网站上也能保证很高的成功率。

- 企业级安全: 该平台已通过 ISO/IEC 27001:2022 认证,确保高水平的数据安全性和隐私性。

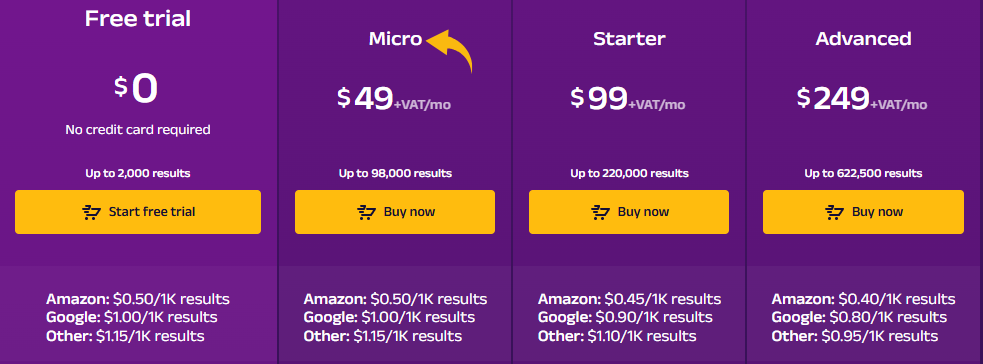

定价

- 免费试用: $0.

- 微: 每月 49 美元 + 增值税。

- 起动机: 每月99美元+增值税。

- 先进的: 每月 249 美元 + 增值税。

优点

缺点

4. 浏览 AI(⭐3.8)

Browse AI 是一个无需编写代码的网站 刮削工具.

它能让你训练机器人从任何网站抓取数据。点击式界面让数据提取变得简单易行。

它还包含用于社交媒体数据的预置机器人,使其成为营销人员的绝佳网络爬虫。

利用我们的 浏览人工智能教程.

我们的观点

想节省时间并获取所需数据吗?浏览 AI 可以处理数百万个网站。看看网页抓取原来如此简单。

主要优势

- 无需编写代码: 它的点击式界面让任何人都能在几分钟内构建数据抓取工具。

- 人工智能驱动的适应性: 该工具能够自动适应网站布局的变化,确保您的数据始终保持一致。

- 7000 多个集成: 轻松将抓取的数据连接到 Google Sheets、Airtable 和 Zapier 等应用程序。

- 预制机器人: 访问预置机器人库,这些机器人可以执行热门网站上的常见任务,从而节省您更多时间。

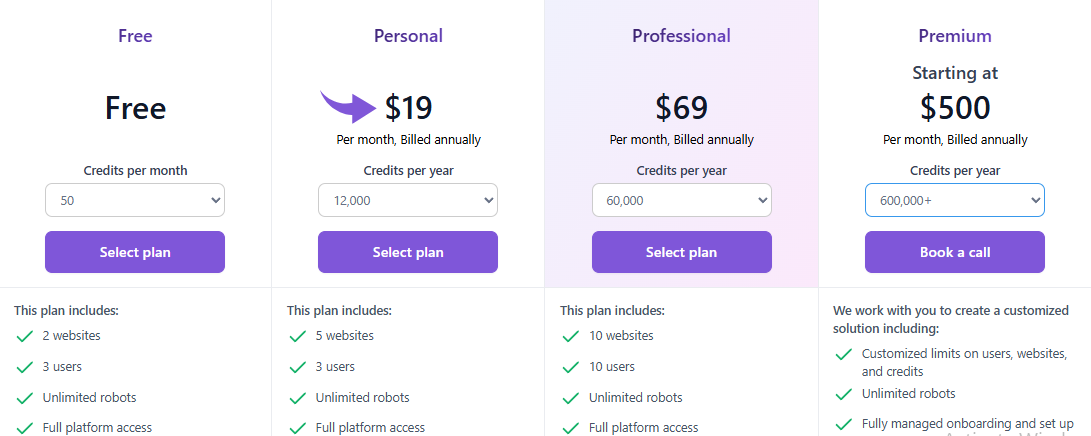

定价

所有计划都将是 按年计费.

- 自由的: $0.

- 个人的: 每月19美元。

- 专业的: 每月69美元。

- 优质的: 每月起价 500 美元。

优点

缺点

5. Zyte(⭐3.5)

Zyte 是一个用于网络爬虫的全栈平台。

它已经存在很长时间了,并且深受许多人的信赖。

它帮助开发者在云端托管和管理网络爬虫。他们还提供强大的API,可以自动处理反机器人防御措施。

Zyte的平台专为大规模社交媒体数据提取而设计。

我们的观点

获取最可靠的网站 数据 使用 Zyte API,这款高质量的网页抓取 API 可帮助您实现项目 99.99% 的数据准确率,并立即简化您的数据提取流程。

主要优势

- 自动解锁: 别再费劲地切换代理了;Zyte API 是一个功能强大的自动化工具,可以用来处理封号。

- 无缝集成Scrapy: 如果你是一名使用 Scrapy 框架的开发者,那么 Zyte 非常适合你。

- 人工智能驱动的数据提取: 该工具可以自动识别和解析数据,从而减少对手动解析规则的需求。

- 集成式无头浏览器: 无需使用第三方无头浏览器,因为 Zyte 提供了一个针对大规模网络抓取进行优化的浏览器。

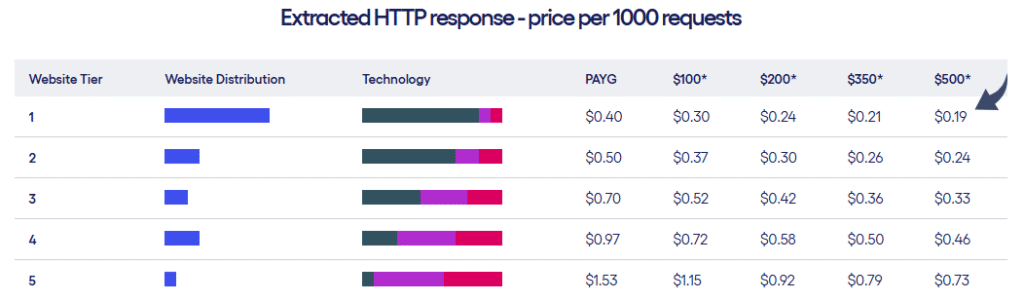

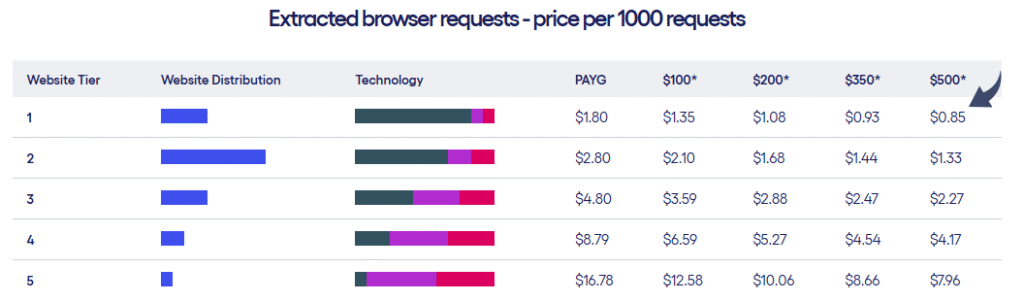

定价

- Zyte 根据网站级别和请求数量提供两种定价方案。

优点

缺点

6. ScrapeGraph AI (⭐3.2)

ScrapeGraph AI 是一个独特的 Python 库,它利用人工智能技术来抓取网站内容。

你只需用简单的英语告诉它你想获取哪些信息即可。

然后它采用基于图的方法来提取数据。

这是一种全新的网络爬虫方法。这款人工智能工具简化了复杂的数据提取过程。

我们的观点

超过 350 位业内专家信赖 ScrapeGraphAI 强大的 AI 驱动型网页抓取功能。立即注册,即可在未来 48 小时内享受 20% 的效率提升。

主要优势

- 自然语言抓取: 你可以使用简单、类似人类的提示来告诉它要提取什么。

- 开源库: 开发者可以利用其强大的开源库来实现最大程度的控制。

- Markdownify 功能: 它可以将整个网页转换为简洁易读的 Markdown 文档。

- Agentic Scraper: 人工智能可以自主浏览网站并与之互动,以完成复杂的多步骤任务。

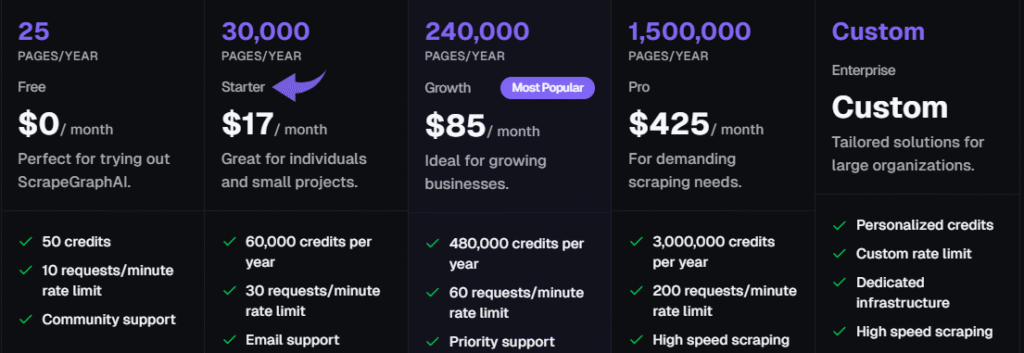

定价

所有计划都将是 按年计费.

- 自由的: 每月0美元。

- 起动机: 每月17美元。

- 生长: 每月85美元。

- 优点: 每月425美元。

- 企业: 定制定价。

优点

缺点

7. ThorData(⭐3.0)

ThorData 是一个提供代理基础设施和网络爬虫工具的平台。

其通用抓取 API 旨在模拟真实的人类行为,以执行高级抓取任务。

这款网络爬虫既提供无需编写代码的选项,也为开发者提供强大的 API。

它可以收集来自社交媒体平台的实时数据。

我们的观点

使用 ThorData,体验无与伦比的安全保障。 数据 验证流程确保 99.7% 的成功率。凭借全天候 24/7 在线支持和平均 3 分钟以内的响应时间,您可以信赖其连接质量。获取超过 6000 万个 IP 地址,保障您的数据安全。

主要优势

- 海量IP池: 提供超过 6000 万个符合道德规范的住宅 IP 地址。

- 高度匿名性: 它利用高质量的代理服务器,确保您的抓取活动不被检测到。

- 按需付费: 计费方式透明;您只需为使用的流量付费,无需为失败的请求付费。

- 内置刮削器: 包含一个无需代码的网络爬虫和一个通用 API,因此对于简单的项目,您不需要单独的工具。

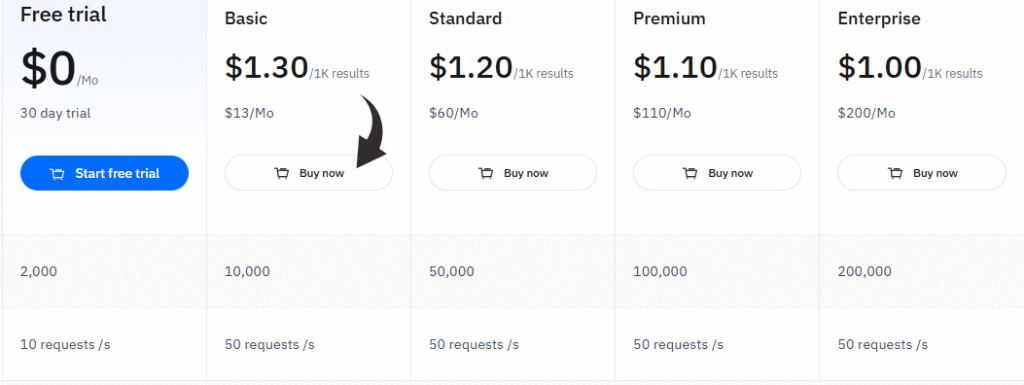

定价

- 免费试用: 每月0美元,30天免费试用。

- 基本的: 每月13美元。

- 标准: 每月60美元。

- 优质的: 每月110美元。

- 企业: 每月200美元。

优点

缺点

买家指南

我们从几个关键因素对每款产品进行评估,以确保我们的推荐是最好的。

我们研究了每个网络爬虫的独特之处以及可能存在的不足。

我们的研究过程很简单,重点在于为您提供做出正确选择所需的信息。

以下是我们的做法:

- 定价: 我们查看了每款工具的定价,包括它们是否提供免费试用或免费入门计划。我们研究了多种定价模式,以找到适合不同预算的选择。

- 特征: 我们深入研究了每款工具的功能。我们考察了诸如用户友好的点击式界面、处理实时数据的能力以及是否提供强大的API等特性。我们还检查了它们是否集成了Google Sheets,以便更轻松地收集数据。

- 缺点: 我们寻找了所有潜在的缺点。它的学习曲线是否陡峭?该工具在应对反爬虫防御方面是否吃力?是否存在某些缺失功能,导致该工具在某些任务上的实用性降低,例如…… 抖音 或者其他特定平台,例如社交媒体?

- 支持与社区: 我们调查了每项服务提供的支持类型。我们查看了他们是否设有社区论坛、提供实用教程或提供直接的客户支持。我们还考虑了他们的退款政策。

- 表现: 我们评估了每种工具提取数据并将其转换为干净、结构化数据的能力。我们还考察了爬虫程序在不被阻塞的情况下应对常见挑战的能力。

- 人工智能集成: 我们寻找使用人工智能代理或其他人工智能功能的工具,以使网络爬虫更加智能、更加高效。

总结

找到最适合您需求的工具可能是一项挑战。

我们研究了许多不同的方案,以帮助您找到最佳的网络数据抓取工具。

我们考虑了关键功能、定价以及用户操作的便捷性。

现在您可以选择一款适合您的工具。

无论您需要的是简单的点击式界面,还是能够处理复杂请求的强大 API。

通过选择合适的工具,您可以从各种平台和网站提取数据,以帮助您构建所需的扩展功能。

常见问题解答

Is web scraping illegal?

Generally, no. It’s legal for public data. Courts, like in the hiQ vs. LinkedIn case, have protected the scraping of publicly available information. However, bypassing paywalls or harvesting personal data is a legal “no-go.” Always respect a site’s robots.txt file.

Is it possible to scrape data from a website?

Absolutely. Almost any public site can be scraped. While some sites use advanced anti-bot shields, modern tools like ScraperAPI are designed to bypass these blocks effortlessly. If the data is visible to a standard browser, a scraper can likely extract it.

Which is best for web scraping?

It depends on your skill. Developers typically swear by Scrapy or BeautifulSoup for total customization. If you prefer a visual approach, Octoparse is the winner. For massive enterprise projects requiring heavy anti-bot protection, 明亮数据 is the undisputed industry leader.

What is the best tool for web scraping?

Bright Data is widely considered the best for power and reliability. It handles proxy rotation and CAPTCHAs without breaking a sweat. For those on a budget, ParseHub or Octoparse offer excellent free tiers that work perfectly for smaller, straightforward projects.

Which scraping tool is best for beginners?

Octoparse is the gold standard for non-coders. It features a point-and-click interface, allowing you to select data directly on the screen. No coding required. ParseHub is another fantastic visual alternative that makes complex data extraction feel like a simple walkthrough.

Can ChatGPT create a web scraper?

Yes, and it’s fast. ChatGPT can generate Python scripts using BeautifulSoup or Selenium in seconds. While it provides the logic, you still need to execute the code yourself. It’s perfect for simple tasks, though complex sites might require some manual fine-tuning.

What is an example of web scraping?

Price monitoring is the classic use case. Retailers scrape sites like Amazon to adjust their own prices dynamically. Other examples include pulling 房地产 listings, gathering sports stats for analysis, or aggregating news for AI training. It turns the web into a structured database.

More Facts about Scrape creators Alternatives

- ScrapingBee, Apify, and Octoparse are great choices if you don’t want to use Scrape Creators. They work well for social media and online shops.

- In 2026, the best tools for getting data from websites are Bright Data, ScrapingBee, Apify, and Octoparse.

- ScrapingBee is a helpful tool that handles tricky website code and hides your identity while you work.

- ScrapingFish is built to be very fast and doesn’t waste any time.

- ScrapingAnt is an easy-to-use tool that gets the job done without any extra fuss.

- Scrapfly is a simple tool that can grow as your project gets bigger.

- ZenRows is great at getting past “robot blockers” on modern websites to get the info you need.

- Oxylabs has a special tool that helps it get into “stubborn” websites that try to block users.

- A web scraper is good for projects that need to pull large amounts of data regularly. It can even read websites that change or update while you are looking at them.

- Scraper API lets you take data from any public site without worrying about technical blocks like “I am not a robot” tests (CAPTCHA). You can even try it for free for 7 days.

- ParseHub is a program you download to your computer that helps you get data without writing any code.

- Scrapy is a famous tool for giant projects, but it’s like a “manual” car—you have to set up the tricky parts yourself.

- Most of these tools are easy to use, with simple buttons that make the work easier. Many “no-code” tools can do the work automatically, saving you time.

- No-code tools are smart enough to read websites that use complex computer code (JavaScript).

- You can save your data in common files like Excel, Google Sheets, or simple lists (JSON).

- Some tools have “starter kits” or templates that help you begin scraping popular websites right away.

- Bright Data has the world’s largest network, with over 150 million connections. It is a specialist at helping people scrape shopping websites.

- Web scraping APIs make it much easier to pull information off the web and turn a messy website into a neat, organized list.

- People use these tools for things like market research or seeing what prices their competitors are charging.

- Octoparse has a “visual 建筑商” that automatically highlights lists and tables on a website for you. It lets you turn any website into a list without knowing how to code.

- 火行者 is a newer tool made specifically for AI. It turns web pages into a format that AI programs like to read.

- Selenium and Playwright are tools that act like a real person clicking and scrolling on a website.

- Kadoa is a very smart tool that figures out what data is on its own, even if the website changes its layout.

- Oxylabs has an AI helper called OxyCopilot that lets you request the data you want using everyday words.