Czy masz problemy z wysokimi kosztami serwerów proxy lub skomplikowaną konfiguracją?

Być może pracujesz nad dużym projektem i potrzebujesz dostawcy, który po prostu pracuje, nie sprawiając Ci ciągłych problemów.

Prawda jest taka, że podczas gdy Jasne dane jest ważnym graczem, ale nie jest jedyną grą w mieście.

A co, gdybyś znalazł dostawcę serwerów proxy oferującego lepszą równowagę między wydajnością i łatwością użytkowania?

W tym artykule przedstawimy najlepsze alternatywy dla Bright Data i pomożemy Ci odkryć inteligentniejsze rozwiązanie, które dokładnie spełni Twoje potrzeby w roku 2025.

Jakie są najlepsze alternatywy dla Bright Data?

Prawdopodobnie szukasz usługi szybszej, tańszej lub po prostu lepiej odpowiadającej Twoim potrzebom.

Dobra wiadomość jest taka, że masz o wiele więcej świetnych możliwości wyboru w porównaniu z Bright Data.

Wykonaliśmy za Ciebie ciężką pracę i przygotowaliśmy listę najlepszych alternatyw dla Bright Data.

Przyjrzyjmy się naszym rekomendacjom i znajdźmy idealne rozwiązanie dla Twoich projektów.

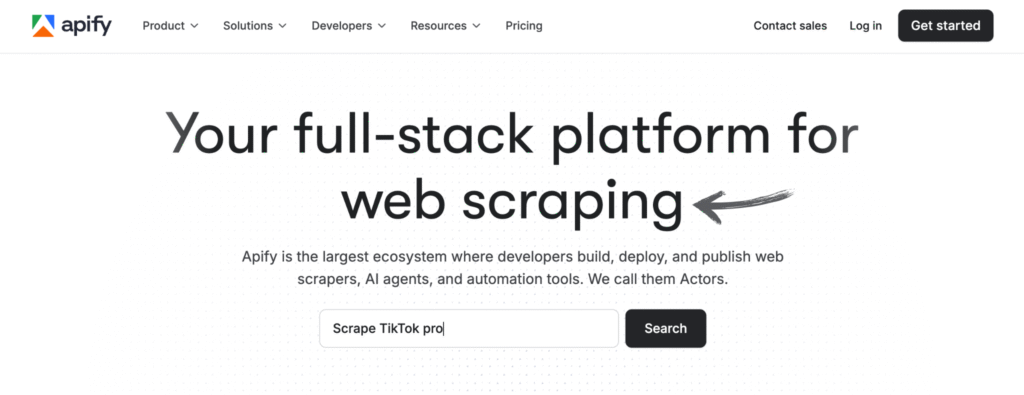

1. Apify (⭐4.8)

Apify to coś więcej niż tylko usługa proxy.

Można to postrzegać jako platformę do scrapowania stron internetowych i automatyzacja.

Możesz używać gotowych aktorów do pobierania danych z witryn internetowych bez konieczności pisania dużej ilości kodu.

To świetna alternatywa dla Bright Data dla tych, którzy poszukują kompletnego, elastycznego systemu do skomplikowanych zadań web scrapingu.

Nasze podejście

Chcesz przekonać się na własne oczy o możliwościach Apify? Nasza platforma została wykorzystana do zeskanowania ponad 2,5 miliona stron internetowych i przetworzenia ponad 500 TB danych w ciągu jednego miesiąca. Gotowy do działania?

Kluczowe korzyści

- Ogromny rynek: W sklepie Apify Store dostępnych jest ponad 5000 gotowych do użycia programów do scrapowania i automatyzacji, zwanych aktorami.

- Maksymalna skalowalność: Zaprojektowane do zadań na poziomie korporacyjnym, umożliwia przetwarzanie na dużą skalę milionów stron.

- Przyjazne dla programistów: Udostępnia pakiet SDK typu open source i obsługuje niestandardowy kod w językach Python i JavaScript.

- Zaawansowane planowanie: Zautomatyzuj zadania scrapowania, aby były wykonywane w określonych godzinach lub odstępach czasu, bez konieczności wykonywania czynności ręcznych.

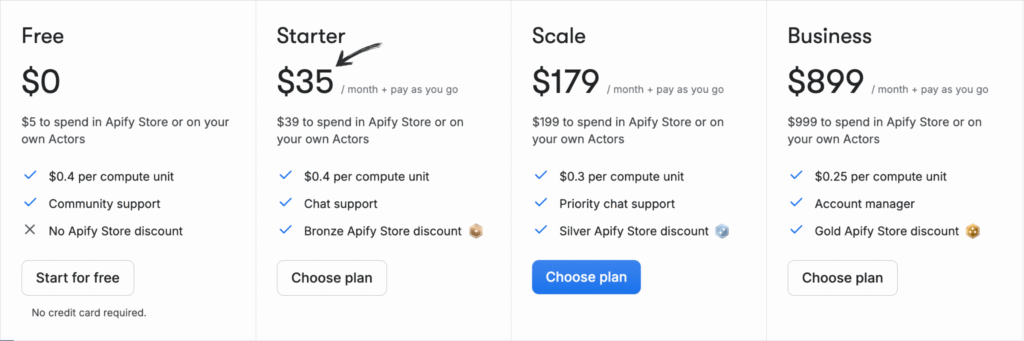

Wycena

Wszystkie plany będą rozliczane rocznie.

- Bezpłatny: 0 zł/miesiąc + Płać zgodnie z zużyciem.

- Rozrusznik: 35 USD/miesiąc + płatność w miarę zużycia.

- Skala: 179 USD/miesiąc + Płać za zużycie.

- Biznes: 899 USD/miesiąc + płatność w miarę zużycia.

Zalety

Wady

2. ScrapingBee (⭐4.5)

ScrapingBee to interfejs API do scrapowania stron internetowych, zaprojektowany w celu robić Twoje życie łatwiejsze.

Obsługuje za Ciebie wszystkie trudne części scrapowania, takie jak obsługa serwerów proxy i przeglądarek bez interfejsu użytkownika.

Wystarczy wysłać żądanie, a system odeśle potrzebne dane.

Jest to idealne rozwiązanie dla deweloperów, którzy potrzebują prostego i niezawodnego interfejsu API proxy do wyodrębniania danych bez konieczności ciągłego zarządzania nimi.

Nasze podejście

Zdobądź dane Potrzebujesz ich z ponad 98% stron internetowych. Potężne API do scrapowania stron internetowych ScrapingBee oferuje renderowanie JavaScript, API wyszukiwarki Google oraz możliwość ekstrakcji danych strukturalnych z dokładnością do 99,5% na stronach dynamicznych.

Kluczowe korzyści

- Zajmie się wszystkim za Ciebie: Zarządza automatycznie rotacją serwerów proxy i renderowaniem JavaScript.

- Proste API: Za pomocą jednego, prostego wywołania API otrzymasz czyste dane.

- 99,9% czasu sprawności: Platforma charakteryzuje się wysoką niezawodnością i stabilną wydajnością.

- Obszerna dokumentacja: Zawiera przejrzystą i wyczerpującą dokumentację z przykładami kodu dla wielu języków, co ułatwia rozpoczęcie pracy.

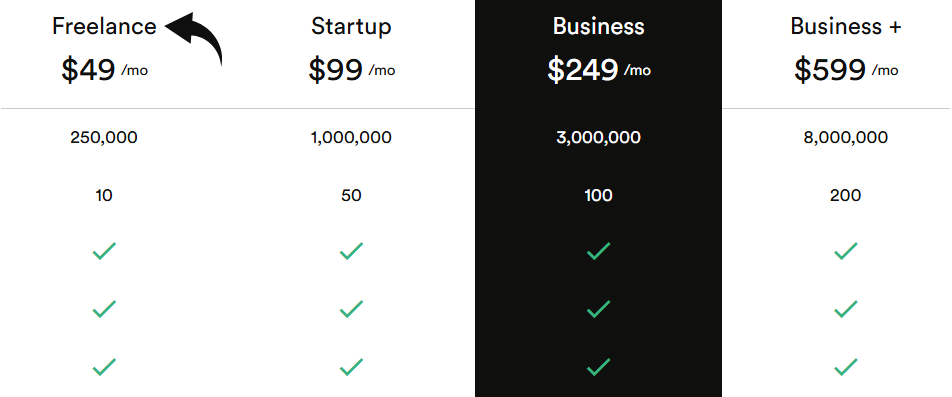

Wycena

Wszystkie plany będą rozliczane rocznie.

- Pracownik nieetatowy: 49 USD/miesiąc.

- Uruchomienie: 99 USD/miesiąc.

- Biznes: 249 USD/miesiąc.

- Biznes+: 599 USD/miesiąc.

Zalety

Wady

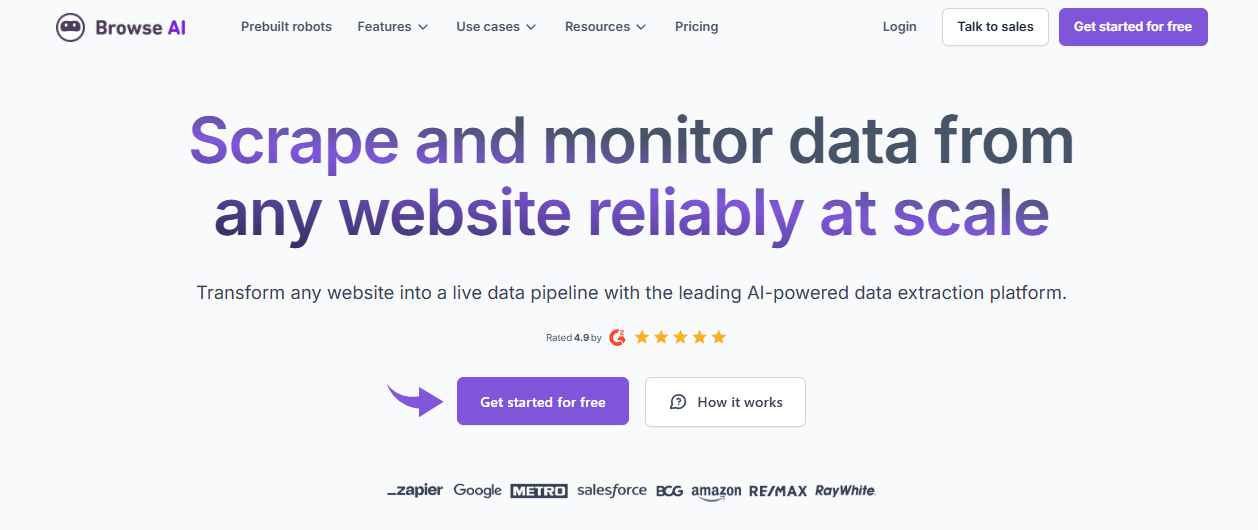

3. Przeglądaj AI (⭐4.0)

Nie umiesz kodować? Żaden problem. Browse AI to nauka bez kodu. narzędzie do scrapowania stron internetowych.

Możesz wyszkolić robota, po prostu wskazując i klikając żądane dane internetowe. To świetne rozwiązanie do monitorowania stron internetowych pod kątem zmian bez żadnych problemów technicznych.

Upraszcza skomplikowane zadania związane ze scrapowaniem stron internetowych, dzięki czemu każdy może je wykonać.

Odkryj jego potencjał dzięki naszemu Przeglądaj samouczek dotyczący sztucznej inteligencji.

Nasze podejście

Chcesz zaoszczędzić czas i uzyskać potrzebne dane? Browse AI poradzi sobie z milionami stron internetowych. Zobacz, jak łatwe może być scrapowanie stron internetowych.

Kluczowe korzyści

- Kod nie jest wymagany: Dzięki interfejsowi typu „wskaż i kliknij” każdy może w ciągu kilku minut stworzyć narzędzie do pozyskiwania danych.

- Adaptacja wspomagana przez sztuczną inteligencję: Narzędzie automatycznie dostosowuje się do zmian w układzie witryny, zapewniając zawsze spójność danych.

- Ponad 7000 integracji: Łatwo połącz zebrane dane z aplikacjami takimi jak Arkusze Google, Airtable i Zapier.

- Gotowe roboty: Uzyskaj dostęp do biblioteki gotowych robotów przeznaczonych do wykonywania typowych zadań na popularnych stronach internetowych, oszczędzając jeszcze więcej czasu.

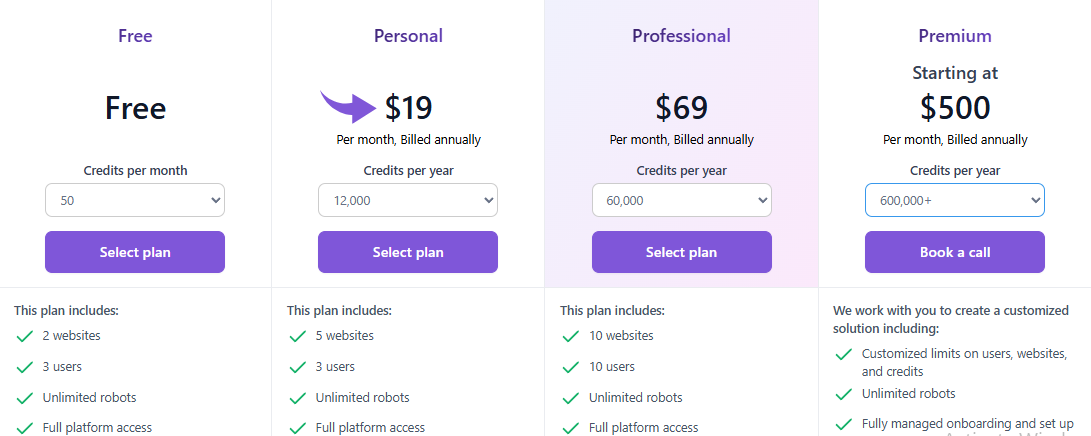

Wycena

Wszystkie plany będą rozliczane rocznie.

- Bezpłatny: $0.

- Osobisty: 19 USD/miesiąc.

- Profesjonalny: 69 USD/miesiąc.

- Premia: Od 500 USD/miesiąc.

Zalety

Wady

4. Oxylabs (⭐3.8)

Oxylabs to gigant w świecie proxy.

Są bezpośrednim konkurentem Bright Data i skupiają się na dostarczaniu wysokiej jakości usług ekstrakcji danych na dużą skalę.

Jeśli realizujesz duże projekty i potrzebujesz niezawodnej wydajności i szybkości, Oxylabs jest mocnym kandydatem.

Oferują ogromną liczbę serwerów proxy domowych i mobilnych, które poradzą sobie z każdym zadaniem.

Nasze podejście

Odblokuj dane dzięki wiodącej usłudze proxy. Z ponad 175 milionami serwerów proxy domowych, 2 milionami dedykowanych serwerów proxy w centrach danych i 20 milionami serwerów proxy mobilnych, Oxylabs zapewnia adresy IP potrzebne do każdego projektu.

Kluczowe korzyści

- Asystent AI OxyCopilot: To narzędzie umożliwia generowanie żądań scrapowania przy użyciu prostego, naturalnego języka.

- Ogromna sieć proxy: Posiada jedną z największych pul serwerów proxy na świecie, obejmującą adresy IP ze 195 krajów.

- Gwarancja sukcesu: Oparte na sztucznej inteligencji odciski palców platformy i omijanie testu CAPTCHA gwarantują wysoki wskaźnik powodzenia nawet w przypadku najtrudniejszych witryn.

- Bezpieczeństwo klasy korporacyjnej: Platforma posiada certyfikat ISO/IEC 27001:2022, co gwarantuje wysoki poziom bezpieczeństwa i prywatności danych.

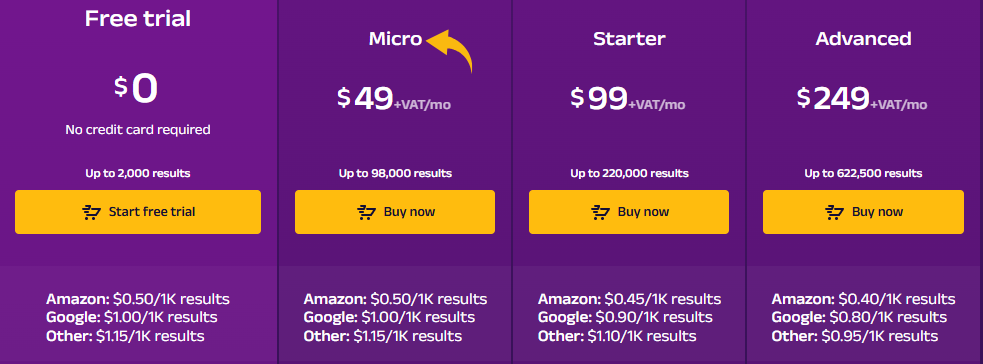

Wycena

- Bezpłatny okres próbny: $0.

- Mikro: 49 USD/miesiąc + VAT.

- Rozrusznik: 99 USD/miesiąc + VAT.

- Zaawansowany: 249 USD/miesiąc + VAT.

Zalety

Wady

5. Zyte (⭐3,5)

Zyte to kompleksowa usługa umożliwiająca scrapowanie stron internetowych i ekstrakcję danych z sieci.

Jest dobrze znany ze swojego inteligentnego menedżera proxy, który automatycznie obsługuje bloki.

Celem Zyte jest zajęcie się problemami natury technicznej, tak aby Ty mógł skupić się na szybkim i bezproblemowym uzyskaniu potrzebnych danych.

Ich interfejs API proxy jest zaprojektowany z myślą o dużej wydajności i niezawodności.

Nasze podejście

Uzyskaj najbardziej niezawodną sieć dane z API Zyte. Osiągnij 99,99% dokładności danych w swoich projektach dzięki temu wysokiej jakości API do scrapowania stron internetowych i usprawnij proces ekstrakcji danych już dziś.

Kluczowe korzyści

- Automatyczne odblokowywanie: Przestań żonglować serwerami proxy; Zyte API to potężne, zautomatyzowane narzędzie do obsługi banów.

- Bezproblemowa integracja ze Scrapy: Jeśli jesteś programistą korzystającym z frameworka Scrapy, Zyte będzie dla Ciebie idealnym rozwiązaniem.

- Ekstrakcja danych wspomagana sztuczną inteligencją: Narzędzie może automatycznie identyfikować i analizować dane, zmniejszając potrzebę ręcznego stosowania reguł analizy.

- Zintegrowana przeglądarka bez interfejsu: Nie ma potrzeby korzystania z przeglądarek bezgłowych innych firm, ponieważ Zyte udostępnia przeglądarkę zoptymalizowaną pod kątem scrapowania stron internetowych na dużą skalę.

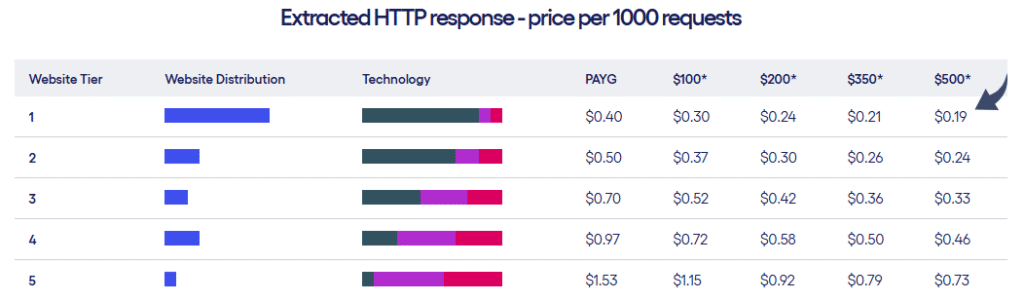

Wycena

- Zyte oferuje dwa rodzaje planów cenowych w zależności od poziomu witryn i liczby żądań.

Zalety

Wady

6. Twórcy scrapowania (⭐3.2)

Scrape Creators to specjalistyczna usługa dla media społecznościowe dane.

Dostarcza dane w czasie rzeczywistym z platform takich jak YouTube i Twittera poprzez proste API.

Jest on przeznaczony dla osób, które potrzebują szczegółowych informacji na temat mediów społecznościowych, bez konieczności korzystania ze skomplikowanych interfejsów API i subskrypcji.

Dzięki temu jest to skuteczna alternatywa dla Bright Data w przypadku zadań związanych ze scrapowaniem stron internetowych.

Nasze podejście

Nie musisz już męczyć się ze zbieraniem danych z mediów społecznościowych. Dzięki Scrape Creators uzyskasz dane w czasie rzeczywistym z platform takich jak Twitch i Pinterest. Dołącz do setek użytkowników, którzy zebrali ponad 6 milionów zapytań i uzyskaj potrzebne Ci informacje.

Kluczowe korzyści

- Specjalistyczne interfejsy API: Oferuje gotowe rozwiązania przeznaczone specjalnie dla platform mediów społecznościowych.

- Nie potrzeba kluczy API: Możesz ominąć konieczność posiadania oficjalnych kluczy API w przypadku witryn takich jak Twitch.

- Płać za zużycie: Płacisz tylko za to, z czego korzystasz, a Twoje środki nigdy nie wygasają.

- Bogate dane JSON: Interfejsy API udostępniają czyste i ustrukturyzowane dane JSON, dzięki czemu nie musisz wykonywać dodatkowego przetwarzania.

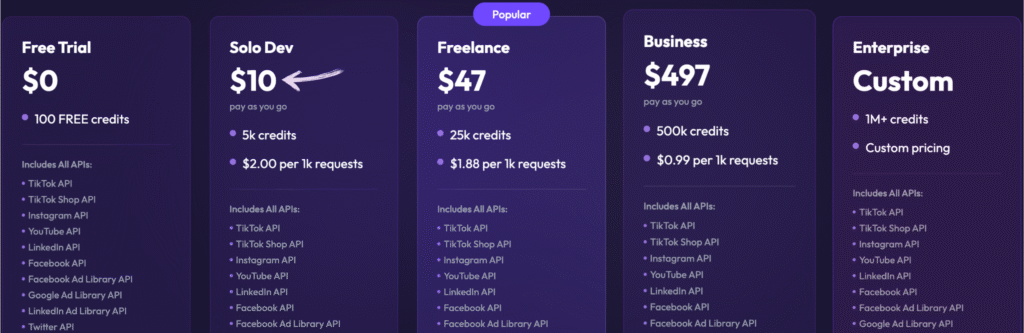

Wycena

- Bezpłatny okres próbny: 0, 100 darmowych kredytów.

- Solo Dev: 10 USD – Płać w miarę użytkowania, 5 tys. kredytów.

- Pracownik nieetatowy: 47 USD – Płać w miarę użytkowania, 25 tys. kredytów.

- Biznes: 497 USD – Płać w miarę użytkowania, 500 tys. kredytów.

- Przedsiębiorstwo: Cena niestandardowa, ponad 1 mln kredytów.

Zalety

Wady

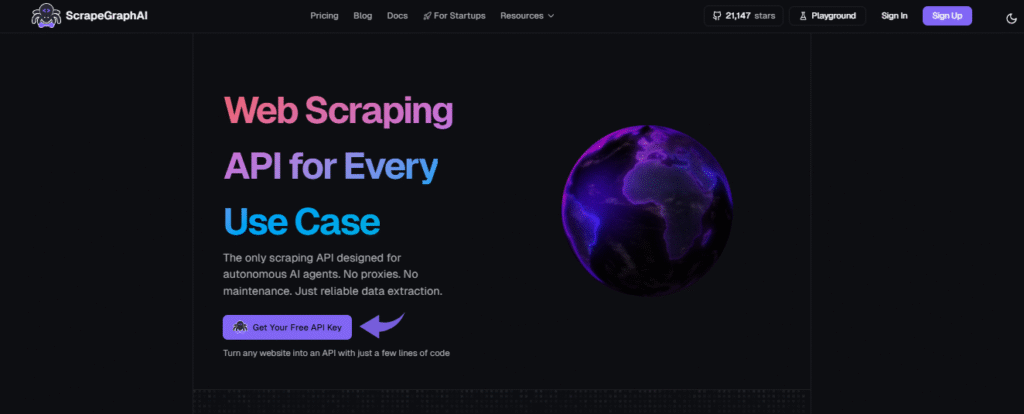

7. Sztuczna inteligencja ScrapeGraph (⭐3.0)

ScrapeGraph AI to narzędzie typu open source wykorzystujące sztuczną inteligencję do uproszczenia scrapowania stron internetowych.

Wystarczy podać adres URL i prosty monit w języku angielskim, a program sam znajdzie sposób na uzyskanie potrzebnych danych.

To świetna opcja zarówno dla programistów, jak i użytkowników nietechnicznych lub ekspertów, którzy chcą wykorzystać sztuczną inteligencję do wyodrębniania danych.

To idealne API proxy do inteligentnego gromadzenia danych.

Nasze podejście

Wiodący specjaliści (ponad 350 osób) zaufali ScrapeGraphAI ze względu na jego solidne, oparte na sztucznej inteligencji możliwości scrapowania stron internetowych. Zapewnij sobie 20% wzrost wydajności na kolejne 48 godzin.

Kluczowe korzyści

- Scraping języka naturalnego: Możesz wskazać mu, co ma wyodrębnić, używając prostych, zrozumiałych dla człowieka monitów.

- Biblioteka Open Source: Deweloperzy mogą wykorzystać jego wszechstronną bibliotekę typu open-source, aby uzyskać maksymalną kontrolę.

- Funkcja Markdownify: Potrafi konwertować całe strony internetowe na przejrzyste, czytelne dokumenty Markdown.

- Agentic Scraper: Sztuczna inteligencja potrafi autonomicznie poruszać się po stronach internetowych i wchodzić z nimi w interakcje, wykonując złożone, wieloetapowe zadania.

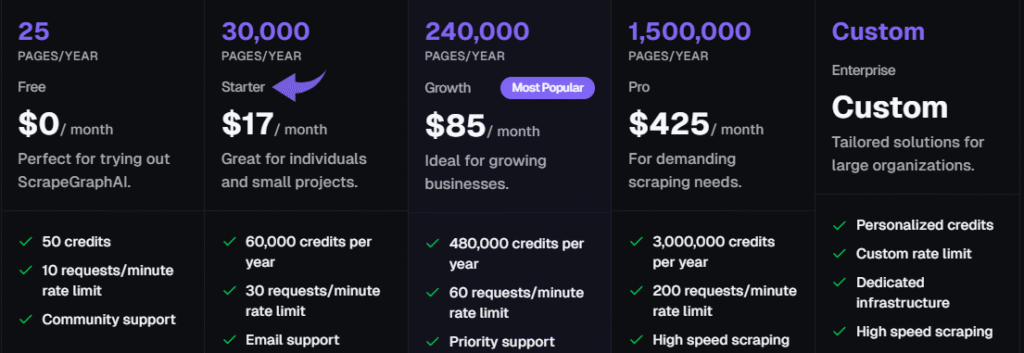

Wycena

Wszystkie plany będą rozliczane rocznie.

- Bezpłatny: 0 zł/miesiąc.

- Rozrusznik: 17 USD/miesiąc.

- Wzrost: 85 USD/miesiąc.

- Zawodowiec: 425 USD/miesiąc.

- Przedsiębiorstwo: Indywidualne ceny.

Zalety

Wady

Przewodnik kupującego

Wiemy, że poruszanie się po rynku serwerów proxy może być przytłaczające.

Aby zapewnić Ci naprawdę przydatny przewodnik, nie skupiliśmy się wyłącznie na twierdzeniach marketingowych.

Zamiast tego przeprowadziliśmy dogłębną analizę, aby dostarczyć Ci najcenniejszych informacji.

Oto szczegółowy opis naszego procesu badawczego:

- Pierwsze odkrycie: Zaczęliśmy od zidentyfikowania wszystkich kluczowych graczy na rynku proxy, w tym znanych marek i innych dostawców proxy. Poszukiwaliśmy również darmowych alternatyw, aby sprawdzić, czy są one realnymi opcjami.

- Ustalanie faktów: Następnie oceniliśmy każdą usługę w oparciu o jasny zestaw czynników. Zbadaliśmy różne oferowane typy serwerów proxy, takie jak proxy domowe i proxy mobilne. Sprawdziliśmy również ich adresy IP i możliwości rotacji adresów IP. W przypadku każdej usługi wzięliśmy pod uwagę cenę, funkcje i wady zgłaszane przez użytkowników, aby uzyskać pełny obraz.

- Analiza cech: Dogłębnie przeanalizowaliśmy funkcje, które są najważniejsze dla użytkowników. Szukaliśmy takich elementów, jak niezawodny menedżer proxy, obsługa renderowania JavaScript oraz opcje przeglądarek bez interfejsu użytkownika. Zwróciliśmy również szczególną uwagę na ich modele cenowe, zwłaszcza jeśli oferowali plany oparte na żądaniach lub bezpłatny okres próbny.

- Wydajność i niezawodność: Przyjrzeliśmy się opiniom użytkowników na temat wydajności, szybkości i gwarantowanego czasu sprawności. To pomogło nam zrozumieć, jak narzędzia sprawdzają się w rzeczywistych sytuacjach, od generowania leadów po pozyskiwanie danych na dużą skalę.

- Wsparcie i społeczność: Na koniec sprawdziliśmy obsługę klienta. Przyjrzeliśmy się dostępnym opcjom pomocy i polityce zwrotów. Szukaliśmy również społeczności użytkowników, aby sprawdzić, jak szybko reagują na problemy i czy oferują pomoc w skomplikowanych zadaniach web scrapingu.

Podsumowanie

Aby znaleźć właściwą alternatywę dla Bright Data, trzeba zrozumieć swoje potrzeby.

Niezależnie od tego, czy jesteś programistą, czy osobą próbującą uzyskać dostęp do danych w sieci, istnieje rozwiązanie dla Ciebie.

Przyjrzeliśmy się cenom, interfejsom API i temu, w jaki sposób każda platforma może pomóc Ci osiągnąć wysoki wskaźnik sukcesu w zakresie gromadzenia danych.

Ten przewodnik dostarczy Ci narzędzi, które pomogą Ci podjąć mądrą decyzję.

Teraz już wiesz, na co zwrócić uwagę, dzięki czemu możesz wybrać najlepszą usługę dla swoich projektów i klientów.

Często zadawane pytania

Is Bright Data proxy safe?

Absolutely. They are ISO 27001 certified and enforce strict Know Your Customer (KYC) protocols. Their proxies are whitelisted by major antivirus engines. While the technology is safe, always ensure your scraping activities comply with target site terms and data privacy laws.

Is Bright Data worth it?

Yes, if you need enterprise-grade scale. Their 72M+ residential IPs and 99.9% uptime are industry-leading. While premium-priced, the built-in Web Scraper IDE and automated unblocking save massive development time. It is an investment in reliability and data integrity.

Can I trust Bright Data?

They are trusted by over 20,000 customers, including Fortune 500 firms. Bright Data has also successfully defended the legality of scraping public data in high-profile federal court cases against Meta and X (Twitter). They are the gold standard for transparency.

What is the former name of Bright Data?

The former name is Luminati Networks. Founded in 2014, the company rebranded in March 2021. The change was designed to better reflect their evolution into a comprehensive data collection platform and distance the brand from negative “Illuminati” associations.

Who are Bright Data competitors?

Oxylabs is their primary enterprise rival. For mid-market pricing, Smartproxy (Decodo) and SOAX are top contenders. Developers often look toward Apify or Zyte for scraping-as-a-service, while NetNut and IPRoyal offer competitive residential proxy alternatives.

What is the difference between Bright Data and Smartproxy?

Bright Data is a full-stack data platform with integrated IDEs and ready-made datasets. Smartproxy focuses on affordable, high-speed proxy infrastructure. While Bright Data targets complex enterprise needs, Smartproxy is the go-to for better pricing and user-friendly dashboards.

Is Bright Data a VPN?

No, it is not a traditional consumer VPN. While it routes traffic through different IPs, it is specialized for automated data collection. It lacks the “one-click” encryption features intended for personal browsing and is built for high-concurrency scraping scripts.

More Facts about Bright Data Alternatives

- Oxylabs has the largest group of “residential” IPs, claiming over 175 million. These are real home internet addresses used fairly.

- Oxylabs is very reliable. It works about 99.95% of the time, meaning it almost never fails to get the data you need.

- You can use Oxylabs to view websites in 195 countries worldwide.

- Massive Proxies is very fast. In the US and Europe, it can get a response in about half a second.

- In the US, Massive Proxies has a 99.87% success rate. That is nearly a perfect score!

- Smartproxy gives you access to about 55 million residential proxies (though some older lists say 40 million).

- NetNut says they are the fastest in the world. They have a pool of over 85 million addresses.

- NetNut promises their service stays “up” and running all the time. You can pay based on the number of requests you make.

- ScraperAPI has a huge network of over 90 million addresses across more than 200 countries.

- ScraperAPI uses a “smart” system to switch addresses. This helps it sneak past tricky website blocks.

- In 2026, many people think Decodo is the best deal. It is much faster than Bright Data but costs less.

- Tools like ScrapingBee, ScraperAPI, and Scrapfly are great for developers. They handle complex website code (such as JavaScript) automatically.

- Scrapingdog is a tool that can pull information from almost any website on the internet.

- Massive has a network of over 1 million addresses in 195 countries.

- Cognism is a smart tool that helps companies find and analyze information from many sources.

- Enrich helps businesses extract useful information from PDFs and web pages.

- Grepsr is designed to help companies easily collect and organize data from the internet.

- Octoparse lets you grab data from websites without needing to know how to write computer code.

- Zyte helps businesses gather and study massive amounts of online information very quickly.

- Browse AI makes it easy for anyone to browse a website and collect data from it.

- Oxylabs and Decodo are big rivals. Both are great for huge projects and big companies.

- In 2026 tests, Oxylabs stayed on top with a 99.95% success rate and a very fast speed of 0.6 seconds.

- If you don’t want to use Bright Data, the best other choices are Oxylabs, Decodo, ScrapingBee, ScraperAPI, and Apify.

- Webshare is good for small projects because it offers a free version with 10 proxies.

- Firecrawl is built for AI. It turns web pages into “markdown” (a simple tekst format) much faster than Bright Data.

- By 2026, web scraping will have changed. Most people now use Narzędzia AI that are cheaper than the old, expensive ones.

- Bright Data is well-known, but many people think it costs too much and is too hard to use.

- ScraperAPI is nice because you only pay for the times it actually works, and there is no limit on how much data you use.

- NetNut offers “static” proxies that stay the same and are always ready to use.

- Smartproxy is usually cheaper than other big brands but still gives you 55 million addresses to use.

- SOAX has a large pool of over 155 million addresses. It lets you pick exactly which city or region you want your proxy to come from.